我刚才花了不到 3 分钟,在VmShell服务器和本地都跑通了谷歌最新的Gemma 4 大模型。

总成本:0 元。

不需要买 API,不需要折腾恶心的 Python 环境配置,100% 断网可用,隐私绝对安全。

这是一份保姆级教程,教你如何用 Ollama 把自己的笔记本变成 AI 算力工作站 🧵👇

首先,为什么要这么干?

Gemma 4 的代码和推理能力极强,但天天刷云端 API 真的很烧钱,而且公司/个人的核心代码喂给云端总有泄露风险。

Ollama 就像是“大模型界的 Docker”,它把部署开源模型这种极其复杂的脏活,变得像装个微信一样简单。

/ 下载 Ollama 🦙

直接去 ollama .com 下载对应系统的安装包(Mac/Win/Linux 全支持)。

双击,下一步,安装完成。

没有那些让人崩溃的依赖冲突和环境报错,进度条已经完成了 50%。

2/ 一键拉取并运行 Gemma 4 ⚡

打开你的终端(Terminal/CMD),敲下这一行“魔法咒语”:

ollama run gemma4

Ollama 会自动帮你去拉取模型权重、配置引擎。去泡杯咖啡,等它跑完,你的终端里就会直接跳出一个类似 ChatGPT 的对话框。

Windows版本更简单,选中一个模型后发一条消息会自动下载模型。

3/ 接上好看的图形界面(推荐)🖥️

终端虽然极客,但日常用还是带界面的香。

Ollama 跑起来后,默认会在本地开启一个 11434 端口的 API。这就意味着,你可以把它无缝接入到各种神仙级的免费前端客户端里:

• Chatbox

• Cherry Studio

• AnythingLLM

Windows版本的ollama省去了这一步,它本身就是图形界面。

这套架构最爽的地方在哪里?

🔒 你的核心业务代码和私人文档,永远不会离开你的硬盘。

✈️ 哪怕你在万米高空的航班上,没有 WiFi,你的私人 AI 依然随时待命。

💸 你的 API 账单永远是 $0。

如果你觉得这份 Gemma 4 + Ollama 的部署指南有帮到你:

记得先「点个收藏 🔖」,等你周末折腾电脑时能随时翻出来。

在评论区聊聊👇:你目前电脑里跑的是哪个本地大模型?我正想找几个新模型测一测!

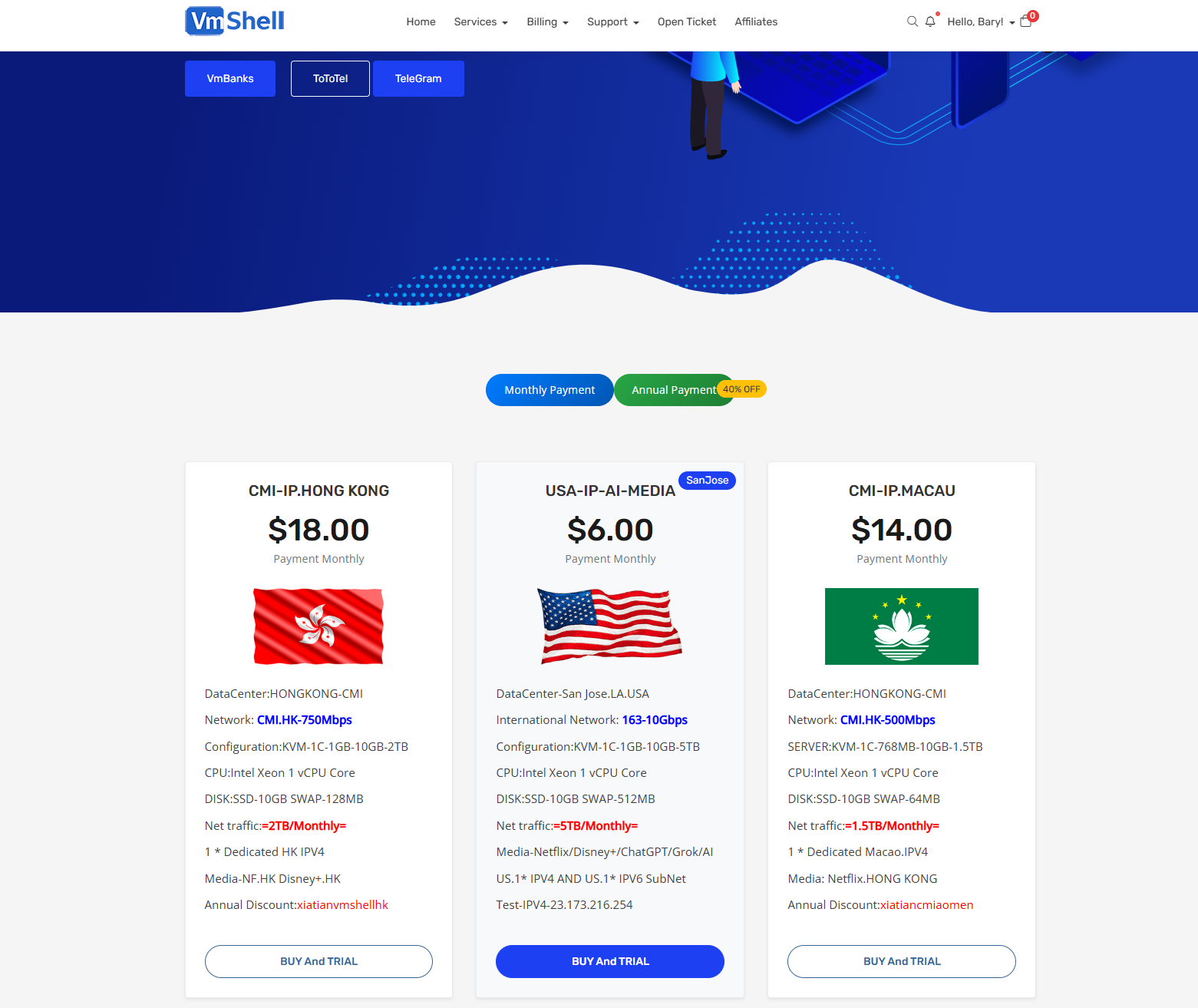

Follow VmShell INC

VPS提供商,https://vmshell.com/,以后分享更多 AI 部署实战干货。

「梦想一旦被付诸行动,就会变得神圣,如果觉得我的文章对您有用,请帮助本站成长」

al2359(3年前 (2023-02-06))

al2359(3年前 (2023-02-06))